Od czego zacząć: jakie zadania ML będą na tym komputerze?

Typowe scenariusze domowego użycia komputera do ML

Sprzęt pod machine learning w domu ma sens dopiero wtedy, gdy jest dobrany do konkretnego sposobu użycia. Inne potrzeby ma student uczący się podstaw scikit-learn, inne osoba, która po pracy trenuje generatory obrazów, a jeszcze inne ktoś, kto chce eksperymentować z lokalnym LLM i fine-tuningiem.

Najczęstsze scenariusze, które realnie pojawiają się w domowych warunkach:

- Nauka ML i klasyczne algorytmy – scikit-learn, XGBoost, proste sieci neuronowe, małe zbiory danych na poziomie kursów.

- Prototypowanie deep learning – PyTorch, TensorFlow, małe CNN-y, segmentacja obrazów, modele do prostych projektów.

- Hobby generatywne – Stable Diffusion, proste diffusion models, GAN-y, czasem własny mały model stylu.

- Entuzjasta LLM – uruchamianie lokalnych modeli językowych (LLaMA, Mistral i podobne), czasem lekki fine-tuning lub LoRA.

- Data scientist po pracy – eksperymenty z modelami przypominającymi produkcję: gradient boosting, małe i średnie sieci, prototypy pipeline’ów.

Każdy z tych scenariuszy inaczej obciąża GPU, RAM i dyski. Zanim dojdzie do wyboru karty graficznej do AI, warto dosłownie spisać, co ma się na tym komputerze dziać: ile godzin trenowania tygodniowo, jakie biblioteki, jaki typ danych (obrazy, tekst, tablice, audio).

Klasyczne uczenie maszynowe vs deep learning vs LLM

Domowy komputer do machine learning może być mocno „przeszacowany”, jeśli ktoś robi głównie klasyczne ML. Algorytmy scikit-learn (drzewa, lasy losowe, SVM, regresje, gradient boosting) zwykle działają na CPU i korzystają głównie z RAM oraz szybkiego dysku. GPU pomaga w niektórych bibliotekach (np. cuML, XGBoost z CUDA), ale nie jest konieczne, by wygodnie się uczyć.

Deep learning (PyTorch, TensorFlow, JAX) zmienia zasady gry. Operacje na macierzach i tensorach są idealne do równoległego liczenia na GPU. Tutaj wybór karty graficznej do ML staje się kluczowy, a ilość VRAM potrafi zadecydować, czy model w ogóle się uruchomi. Dość szybko okazuje się, że CPU jest „tylko” koordynatorem, a cała zabawa dzieje się na karcie.

LLM i inne generatywne modele (np. duże diffusion models) są jeszcze bardziej wymagające. Nie chodzi tylko o moc obliczeniową, ale przede wszystkim o VRAM. Sporo modeli waży dziesiątki gigabajtów w pamięci GPU, nawet przy kwantyzacji. Tu domowy PC do LLM wymaga już przemyślanego zestawu: odpowiednia karta, sporo RAM, szybki dysk NVMe i sensowne chłodzenie, żeby całość mogła pracować przez wiele godzin.

Trenowanie od zera, fine-tuning czy tylko inference?

Kluczowe pytanie brzmi: czy ten komputer ma służyć do trenowania dużych modeli od zera, czy raczej do:

- uczenia się API i konceptów – budowanie prostych sieci, zabawa z notebookami, małe datasety,

- fine-tuningu gotowych modeli – LoRA, adapters, lekkie modyfikacje,

- inference (wnioskowania) – uruchamianie już wytresowanych modeli do generowania wyników.

Trenowanie od zera dużych sieci głębokich (np. pełnego Stable Diffusion na własnym zbiorze obrazów, ciężkich transformerów NLP) w domowych warunkach jest trudne nawet przy bardzo mocnym sprzęcie, głównie przez czas obliczeń i zużycie energii. Często rozsądniej jest:

- do treningu większych modeli używać chmury lub klastrów uczelnianych,

- lokalnie robić inference, małe eksperymenty i fine-tuning fragmentów modelu.

Jeśli głównym celem jest nauka i prototypowanie, inwestycja w ultra-drogie GPU typowo się nie zwraca. Z kolei jeśli ktoś planuje regularnie robić eksperymenty z LLM w domu, wtedy karta z dużą ilością VRAM staje się sensowną inwestycją.

Profil użytkownika a wymagania na sprzęt

Łatwiej dobrać konfigurację, jeśli zdefiniuje się siebie w jednym z uproszczonych profili:

- Student / osoba na kursie ML – głównie notatniki, małe dataset-y, klasyczne ML, pierwsze małe sieci. Wystarczy przyzwoite CPU, 16–32 GB RAM, średnia karta (nawet 8 GB VRAM) lub brak GPU, jeśli deep learning to tylko małe przykłady.

- Data scientist po pracy – dużo notebooków, pandas, XGBoost, czasem PyTorch/TensorFlow. GPU z 8–12 GB VRAM, 32 GB RAM, szybki SSD NVMe 1–2 TB na dane i środowiska.

- Hobbysta od obrazów / generatywny artysta – Stable Diffusion, trenowanie własnych stylów. GPU 12–24 GB VRAM, RAM 32–64 GB, dużo szybkiego miejsca na dysku (NVMe co najmniej 2 TB).

- Entuzjasta LLM – lokalne LLM, LoRA, eksperymenty z różnymi kwantyzacjami. Optymalnie 24 GB VRAM lub więcej, RAM 64 GB (lub minimum 32 GB przy mniejszych modelach), szybki NVMe 2–4 TB.

Od takiego profilu łatwo przejść do konkretnych wymagań: moc GPU (TFLOPS, tensor cores), ilość VRAM, minimalna ilość RAM oraz pojemność i rodzaj dysków.

GPU pod machine learning: najważniejszy element układanki

Dlaczego GPU jest tak ważne w deep learning

Uczenie sieci neuronowych to w ogromnej mierze miliardy prostych operacji na macierzach i tensorach: mnożenia, dodawania, operacje na wektorach. GPU jest projektowane specjalnie po to, by takie operacje wykonywać masowo równolegle, w setkach lub tysiącach rdzeni jednocześnie. CPU jest świetne w różnorodnych, skomplikowanych zadaniach, ale ma stosunkowo niewiele rdzeni i gorzej skaluje się w takich powtarzalnych obliczeniach.

Dlatego praktycznie każdy sensowniejszy projekt deep learning zakłada użycie karty graficznej. Bez niej:

- trenowanie prostego modelu, które na GPU trwa kilka minut, na CPU może zająć godziny,

- więcej czasu mija na czekaniu niż na eksperymentowaniu,

- część modeli po prostu nie zmieści się w RAM lub będzie regularnie powodować „zawieszanie” systemu.

W efekcie GPU staje się centrum decyzji przy budowaniu komputera do machine learning. To pod kartę graficzną dobiera się płytę, zasilacz, obudowę i chłodzenie.

CUDA, cuDNN i przewaga ekosystemu NVIDIA

Kluczowa przewaga NVIDIA w świecie ML to nie tylko hardware, ale cały ekosystem CUDA. CUDA to platforma programistyczna, na której zbudowane są biblioteki wykorzystywane przez PyTorch, TensorFlow i wiele innych narzędzi. Do tego dochodzi cuDNN (biblioteka do sieci neuronowych), gotowe obrazy Dockera, sterowniki pod Linux, Windows, wsparcie w chmurach i na klastrach uczelnianych.

Praktyczne skutki dla domowego użytkownika:

- Instalacja i konfiguracja PyTorch/TensorFlow z CUDA na kartach NVIDIA jest dobrze opisana i stosunkowo przewidywalna.

- Większość gotowych przykładów i kursów zakłada użycie NVIDIA, co zmniejsza liczbę „dziwnych problemów” po drodze.

- Narzędzia typu Docker, Conda, gotowe obrazy kontenerów są przygotowane głównie pod CUDA.

Minusy? Głównie cena i polityka producenta. Karty NVIDIA są zwykle droższe od porównywalnych AMD w segmencie gamingowym, a część funkcji jest celowo ograniczana w kartach konsumenckich w porównaniu z serwerowymi. Mimo to, dla pierwszego komputera pod ML przewaga ekosystemu CUDA często przeważa szalę właśnie na rzecz NVIDIA.

Alternatywy: AMD (ROCm) i GPU Intela

AMD rozwija swoją platformę ROCm, która w teorii ma pełnić podobną rolę jak CUDA. Istnieją wersje PyTorch i TensorFlow, które wspierają AMD, powstają też projekty takie jak OpenCL-owe porty, ale sytuacja jest bardziej skomplikowana. Główne problemy w domowym użyciu to:

- ograniczona lista wspieranych kart i wersji sterowników,

- nierówne wsparcie pod Windows – wiele osób ostatecznie przechodzi na Linux,

- częstsze problemy z kompatybilnością bibliotek,

- mniej gotowych materiałów i przykładów „krok po kroku”.

GPU Intela (integry w nowych CPU, a także dedykowane karty) również mają swoje biblioteki, takie jak oneAPI. Z punktu widzenia domowego ML sytuacja jest podobna: da się coś uruchomić, ale wymaga więcej cierpliwości i kompromisów niż w przypadku CUDA.

Dla osób, które dopiero zaczynają i chcą mieć „po prostu działający” komputer do nauki uczenia maszynowego, eksperymentowanie z AMD/Intel bywa frustrujące. Jeśli celem jest nauka algorytmów, a nie walka z narzędziami, bezpieczniejszym wyborem pozostaje NVIDIA.

System operacyjny, sterowniki i biblioteki

Domowy komputer do ML z NVIDIA zwykle działa w jednym z dwóch układów:

- Windows + WSL2 (Ubuntu) – wygodna praca na Windowsie, a jednocześnie środowisko linuksowe wewnątrz, gdzie działa PyTorch/TensorFlow z CUDA.

- Native Linux (Ubuntu, Pop!_OS, inne dystrybucje) – klasyczny wybór w świecie data science i ML.

Na Windowsie można instalować biblioteki bez WSL, ale część narzędzi powstaje najpierw z myślą o Linuxie. W efekcie coraz więcej osób stawia na WSL2 albo czysty Linux jako główny system dla domowego laboratorium ML.

Przy NVIDIA trzeba zadbać o zgodność wersji: sterowniki GPU, wersja CUDA, wersja PyTorch/TensorFlow. Najprostsza praktyka to instalacja PyTorch/TensorFlow z zalecaną paczką CUDA (często dołączaną w ramach conda/pip), zamiast ręcznego miksowania wersji sterowników i toolkitów.

Kiedy lepiej nie eksperymentować z egzotycznym sprzętem

Jeśli celem jest komputer do nauki ML, budowy portfolio projektów i prototypów, a nie badania nad alternatywnymi frameworkami, sensownie jest ograniczyć „egzotykę”. Oznacza to:

- unikanie kart, do których sterowniki są dostępne tylko w niestandardowych repozytoriach albo wymagają skomplikowanej konfiguracji,

- unikanie bardzo starych GPU, z którymi nowsze PyTorch/TensorFlow nie współpracują (brak wsparcia dla danej wersji CUDA),

- ostrożność z kartami z niszowych serii serwerowych, które wymagają specyficznego chłodzenia i BIOS-u.

Domowe laboratorium ML ma służyć do eksperymentów z modelami, a nie z instalacją sterowników. W większości przypadków solidna karta NVIDIA z serii GeForce RTX z ostatnich dwóch generacji jest po prostu najrozsądniejszym wyborem.

Jak dobrać ilość VRAM: ile pamięci na karcie naprawdę potrzeba?

Rozmiar modelu i typ zadań a wymagania VRAM

VRAM to pamięć dostępna na karcie graficznej. To w niej lądują:

- wagi modelu (parametry),

- aktywacje warstw w czasie forward/backward pass,

- batch danych (obrazy, sekwencje tekstowe itp.),

- bufory robocze bibliotek (np. cuDNN).

Im większy model i im większe dane, tym szybciej kończy się VRAM. Typ zadań ma ogromny wpływ na to, ile pamięci potrzeba:

- Tablice/liczby (klasyczne ML, proste MLP) – zwykle małe wymagania, nawet kilka GB VRAM wystarcza do nauki.

- Obrazy (CNN) – rozdzielczość 224×224 i podobne można trenować na 8–12 GB, ale przy wyższych rozdzielczościach i złożonych modelach apetyt rośnie.

- Sekwencje tekstowe (NLP) – zależą od długości sekwencji (sequence length) i wielkości modelu (liczba parametrów).

- Transformery wizji, diffusion models, LLM – często wymagają 12–24 GB VRAM lub więcej, jeśli chcemy trenować coś większego niż mały demo-model.

Nie chodzi wyłącznie o to, aby „model się uruchomił”. Praca z ciągłym błędem „out of memory” potrafi skutecznie zabić zapał do nauki, więc lepiej dobrać trochę więcej VRAM, niż wynikałoby z absolutnego minimum.

Przybliżone poziomy VRAM dla różnych zastosowań

Praktyczne przedziały VRAM, które dobrze pasują do domowego komputera do ML:

- 8 GB VRAM – poziom startowy. Wystarczy do nauki PyTorch/TensorFlow, prostych CNN-ów, małych transformerów, inference mniejszych modeli. Stable Diffusion da się uruchomić, ale z ograniczeniami (mniejsze rozdzielczości, ostrożny batch size).

- 12 GB VRAM – komfort dla nauki i średniego hobby. Daje luz przy trenowaniu modeli na obrazach, prostych diffusion models, większych CNN i transformerów. Sporo modeli LLM w lekkich kwantyzacjach można uruchomić do inference.

Dlaczego „za mało VRAM” boli bardziej niż „za mało FPS”

Przy grach karta graficzna może „odpuścić”: spadnie liczba klatek, trzeba obniżyć detale i jakoś to idzie. Przy ML, gdy skończy się VRAM, model po prostu nie działa. Błąd „CUDA out of memory” oznacza koniec zabawy z danym ustawieniem – trzeba zmniejszyć batch size, skrócić sekwencję, uprościć model albo użyć sprytnych sztuczek.

Skutki zbyt małej ilości VRAM są bardzo konkretne:

- nie uruchomisz większych modeli lub zrobisz to tylko w wersjach „okrojonych”,

- batch size spada tak nisko, że trening staje się niestabilny i wolny,

- częściej trzeba kombinować z offloadingiem na RAM/dysk, co spowalnia wszystko do poziomu „na granicy sensu”.

Czasem lepiej mieć wolniejszą kartę z większą ilością VRAM niż szybszą z mniejszą. Co z tego, że GPU ma więcej TFLOPS, jeśli model w ogóle się nie mieści?

Techniki oszczędzania VRAM: co realnie działa w domu

Gdy VRAM zaczyna się kończyć, nie trzeba od razu wymieniać karty. Jest kilka mechanizmów, które pomagają „upchnąć” więcej w tej samej pamięci:

- Zmniejszenie batch size – najprostszy krok. Trening trwa dłużej (więcej iteracji), ale często wystarczy, by model wskoczył w dostępny VRAM.

- Mixed precision (FP16/BF16) – trenowanie w niższej precyzji zmniejsza zapotrzebowanie na pamięć nawet dwukrotnie. W PyTorch to pojedyncza flaga lub context manager.

- Gradient checkpointing – zamiast trzymać wszystkie aktywacje warstw, część jest przeliczana ponownie w czasie backpropagacji. Oszczędza VRAM kosztem dodatkowego czasu obliczeń.

- Przycinanie sekwencji/rozdzielczości – krótszy tekst, mniejsze obrazy, mniej klatek w wideo. Czasem wystarczy zejść z 1024 do 512 tokenów, by uniknąć błędu pamięci.

- Fine-tuning zamiast pełnego treningu – zamiast trenować ogromny model od zera, bierzesz gotowy checkpoint i uczysz tylko kilka ostatnich warstw lub adaptery (LoRA, PEFT). Wymagania pamięci potrafią spaść dramatycznie.

W praktyce większość domowych projektów NLP i CV udaje się uruchomić dzięki kombinacji mniejszego batcha i mixed precision. To taka domowa „magia” optymalizacyjna, która często ratuje sytuację.

16, 24 GB i więcej – kiedy ma to sens w domu

Segment „powyżej 12 GB” to już obszar, w którym otwierają się drzwi do rzeczy, które wcześniej były poza zasięgiem:

- 16 GB VRAM – swobodne trenowanie średnich transformerów (tekst i obraz), praca ze Stable Diffusion z większymi rozdzielczościami, pierwsze próby z lekkimi LLM (fine-tuning, LoRA). Komfort dla osób, które wiedzą, że ML to będzie główne hobby lub półzawodowa praca.

- 24 GB VRAM – domena dużych, hobbystycznych eksperymentów: fine-tuning sporych LLM-ów, trenowanie własnych diffusion models, zabawa z większymi modelami wizji (segmentacja, detekcja w wysokiej rozdzielczości). Taka karta często wystarcza na kilka lat intensywnej nauki i pracy nad portfolio.

- Powyżej 24 GB VRAM – sens głównie wtedy, gdy zarabiasz na ML albo budujesz bardzo ambitne projekty badawcze. Do nauki i eksperymentów domowych częściej ograniczeniem będzie czas i energia, a nie sama pojemność VRAM.

Jeśli budżet jest napięty, 12–16 GB VRAM to dziś najbardziej rozsądny cel. Daje swobodę, a jednocześnie nie winduje kosztu całej maszyny do poziomu małego serwera.

Jak sprawdzić, ile VRAM zużywa konkretny projekt

Zamiast zgadywać „czy to się zmieści?”, można podejść do sprawy empirycznie. Na maszynie z GPU:

- odpalasz monitorowanie (np.

nvidia-smiw terminalu albo narzędzia graficzne pod Windows), - uruchamiasz swój kod na małym batchu,

- stopniowo zwiększasz batch size / długość sekwencji i obserwujesz, kiedy kończy się VRAM.

Raz wykonany taki test daje dobry „nosek” na przyszłość: po kilku próbach zaczynasz czuć, jakie modele wymagają ile pamięci i co trzeba zmienić, aby weszły na daną kartę.

Wybór konkretnej karty graficznej: serie, złącza i chłodzenie

Serie kart NVIDIA pod ML: co ma sens, a co omijać

Na rynku jest gąszcz modeli: od starych GTX, przez RTX-y gamingowe, po kosztowne karty serwerowe. Pod domowe ML sprawdzają się głównie trzy grupy:

- GeForce RTX (seria 20xx, 30xx, 40xx) – najczęstszy wybór. Dobra dostępność, rozsądny stosunek cena/wydajność, wsparcie dla mixed precision (Tensor Cores). Dobre do nauki, projektów hobbystycznych i półprofesjonalnych.

- Starsze GTX (10xx, 16xx) – dość mocno „na styk”. Brak Tensor Cores, mniej VRAM, gorsze wsparcie w nowych wersjach frameworków. Jako tymczasowe rozwiązanie tak, jako świadomy zakup pod ML – raczej nie.

- Serwerowe / profesjonalne (Quadro, A-series typu A4000, A5000) – lepsza stabilność, często więcej VRAM, ale też sporo wyższa cena. Sens gdy komputer zarabia pieniądze lub budujesz małe domowe „serwerownię”.

Czasem trafiają się atrakcyjne oferty na używane karty serwerowe (np. z koparek czy z kończących żywot serwerów). Kuszą ilością VRAM, ale potrafią wymagać głośnego chłodzenia i specyficznych zasilaczy. Dlatego do pierwszej domowej stacji roboczej bezpieczniej trzymać się typowych RTX-ów w wersjach od renomowanych producentów.

Jak czytać nazwy modeli i nie przepłacić za „gaming”

Producenci kart uwielbiają dopisywać do nazw różne „Gaming X Turbo Ultra”. Z punktu widzenia ML liczą się głównie:

- ilość VRAM – 8, 12, 16, 24 GB itd.,

- rodzaj pamięci (GDDR6, GDDR6X – różnice są, ale przy domowym ML nie będą kluczowe),

- tj. czy karta ma Tensor Cores – wszystkie RTX tak, stare GTX nie,

- liczba rdzeni CUDA / moc obliczeniowa (TFLOPS) – wpływa na czas treningu.

Różnice między poszczególnymi „gamingowymi” wersjami tej samej karty najczęściej dotyczą chłodzenia, taktowania i wyglądu. Do ML nie potrzebujesz migających diod RGB ani fabrycznego podkręcenia – bardziej przyda się solidne, ciche chłodzenie i niezawodność.

PCIe, długość karty i zasilanie

Większość współczesnych kart korzysta ze złącza PCI Express x16. Przy jednym GPU i typowej płycie głównej nie trzeba się tym specjalnie przejmować – po prostu wkładasz kartę w główne gniazdo PCIe. Pojawiają się natomiast inne praktyczne aspekty:

- Długość i grubość karty – duże RTX-y potrafią zajmować 2,5–3 sloty i mieć ponad 30 cm długości. Sprawdź specyfikację obudowy, aby nie skończyło się cięciem zatok na dyski.

- Złącza zasilania – starsze karty używają 6/8-pin, nowsze high-endowe (np. część 40xx) – nowego 12VHPWR. Zasilacz musi mieć odpowiednie przewody lub przejściówki od producenta.

- Moc zasilacza – przy RTX średniej klasy rozsądnym minimum jest markowy PSU 650–750 W. Przy topowych modelach dobrze celować w 850 W i wzwyż.

Przy jednym GPU do ML nie trzeba popadać w przesadę, ale warto przewidzieć nieco zapasu – dodatkowe 100–150 W mocy zasilacza daje spokój przy późniejszych rozbudowach.

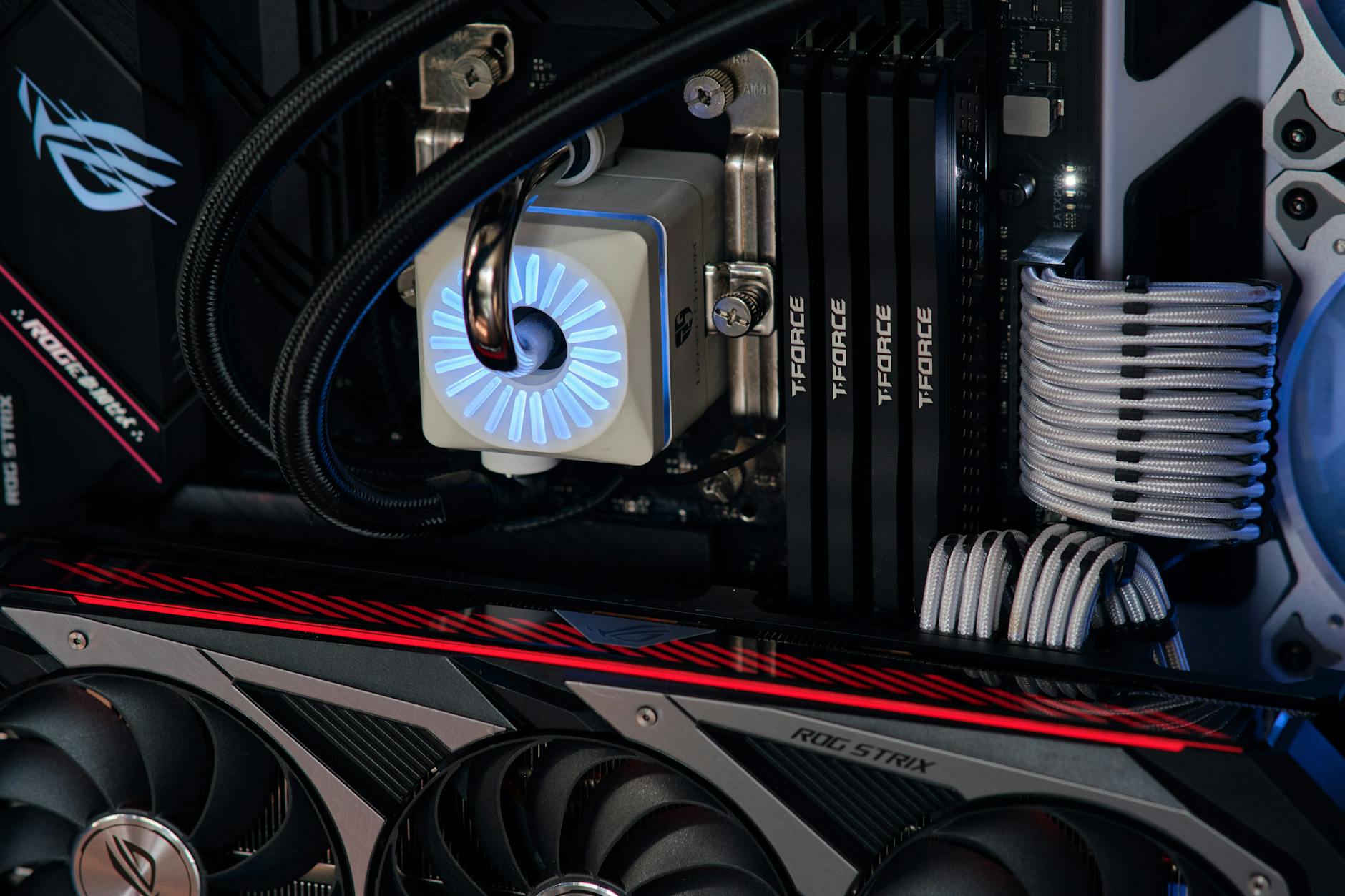

Chłodzenie karty: różnice, które czuć po kilku godzinach treningu

Przy ML karta potrafi pracować pod pełnym obciążeniem przez wiele godzin. To zupełnie inny scenariusz niż kilka minut intensywnej gry. Z tego powodu sposób chłodzenia ma większe znaczenie niż się z początku wydaje.

Najczęstsze typy chłodzenia to:

- Otwarte (dwa lub trzy wentylatory) – najpopularniejsze w kartach gamingowych. Oddają ciepło do wnętrza obudowy. Przy dobrej wentylacji całej obudowy sprawdzają się znakomicie, są też najczęściej cichsze.

- Blower (jeden wentylator, tunel powietrzny) – zrzuca ciepłe powietrze bezpośrednio poza obudowę. Świetny w serwerach i przy wielu GPU obok siebie, ale pojedyncza karta blower potrafi być głośna i cieplejsza w domu.

- Chłodzenie wodne (AIO lub custom) – daje najniższe temperatury i często najniższy hałas, ale podnosi koszt i komplikację zestawu. Raczej dla entuzjastów.

Do typowego domowego PC z jednym GPU najlepszym wyborem jest solidne chłodzenie powietrzem z dwoma lub trzema wentylatorami. Ważniejsze od „gamingowego” brandingu są: jakość łożysk, kultura pracy i realne temperatury w testach.

Używane GPU do ML: na co uważać

Karta z drugiej ręki kusi ceną. Z drugiej – wiele z nich ma za sobą tysiące godzin w koparkach kryptowalut. Da się jednak podejść do tego rozsądnie:

- sprawdź temperatury i zachowanie pod obciążeniem (prosty benchmark GPU + kilka epok treningu w PyTorch),

- obejrzyj stan fizyczny – kurz, ślady po zalaniu, „poddziabane” śrubki przy chłodzeniu,

- zwróć uwagę na dźwięk wentylatorów – głośne wycie albo terkotanie to sygnał zużycia,

- przetestuj stabilność w ML – brak losowych zawieszek podczas dłuższego treningu to dobry znak.

Osoba, która rzeczywiście używała karty do ML lub gamingu, często ma jakieś logi, benchmarki czy przynajmniej rozsądną historię użytkowania. Jeśli sprzedający nie potrafi odpowiedzieć na żadne pytania poza „działa, panie”, lepiej zachować dystans.

RAM – ile pamięci operacyjnej do komfortowej pracy z ML?

Rola RAM w typowym przepływie pracy ML

GPU robi „ciężkie mnożenia”, ale RAM nadal jest krwiobiegiem całego systemu. Tu trzyma się:

- dane w trakcie wstępnego przetwarzania (dataframes, zbiory obrazów, tokenizowane teksty),

- część buforów frameworków ML (PyTorch, TensorFlow, biblioteki przetwarzania danych),

- kilka środowisk programistycznych naraz (IDE, Jupyter, przeglądarka z dokumentacją, Docker).

Gdy RAM się zapełni, system zaczyna „swapować” na dysk. W praktyce wygląda to jak całkowite zamrożenie komputera – kursor się porusza, ale otwarcie terminala trwa minutę. Znasz to? To znak, że RAM stał się wąskim gardłem.

Przedziały pojemności RAM a scenariusze użycia

Można wyróżnić kilka praktycznych poziomów RAM dla domowego ML:

- 16 GB RAM – absolutne minimum na start, jeśli robisz naprawdę proste projekty i jednocześnie nie odpalasz kilku „ciężkich” aplikacji. Przy PyTorchu, przeglądarce i edytorze kodu szybko poczujesz ścianę.

- 32 GB RAM – sensowna baza dla większości osób uczących się ML. Umożliwia trzymanie w pamięci większych datasetów, uruchamianie Dockerów, kilku środowisk conda i jednocześnie komfortową pracę w systemie.

- 64 GB RAM – poziom „wygodnie i z zapasem”. Przydaje się, gdy:

- pracujesz z dużymi tabelami (miliony wierszy) w pandas/Polars,

- robisz preprocessing tekstu/obrazu przed wysłaniem na GPU,

- uruchamiasz kilka kontenerów lub maszyn wirtualnych.

- 128 GB i więcej – raczej gdy budujesz domowy serwer do wielu zadań naraz albo operujesz na ogromnych zbiorach danych w pamięci. Do nauki ML i pojedynczych projektów to często przesada.

Jeśli budujesz komputer „na lata” i możesz dołożyć, 32 GB jako punkt startowy jest dziś bardzo rozsądnym wyborem. Przy bardziej ambitnych projektach z CV/NLP 64 GB szybko pokazuje swoją zaletę.

RAM a rozmiar datasetu: kiedy wystarczy „strumieniowanie z dysku”

Nie każdy zbiór danych musi w całości mieścić się w RAM. Frameworki ML mają mechanizmy strumieniowania i lazy loadingu. Kilka typowych podejść:

- Dataset z obrazami na dysku – klasyczny przypadek. Ładuje się niewielkie porcje obrazów do RAM/GPU w locie. Przy dobrym loaderze nawet dziesiątki czy setki gigabajtów danych można trenować na 32–64 GB RAM.

Struktury danych w pamięci: kiedy RAM zaczyna się „pocić”

Oprócz samego rozmiaru zbioru danych liczy się to, w jaki sposób jest on trzymany w RAM. Dwie struktury różniące się tylko szczegółami mogą zajmować kilkukrotnie inną ilość pamięci.

- DataFrame’y pandas – wygodne, ale potrafią być pamięciożerne. Kopiowanie kolumn, łączenia, sortowania – każde z nich może tymczasowo wymnożyć zużycie RAM.

- Listy obiektów Pythona – każdy element ma własny „narzut” na metadane. Tysiące małych obiektów są gorsze niż jedna zwarta tablica NumPy.

- Tablice NumPy / tensory – zwykle znacznie oszczędniejsze, bo dane leżą „ciągiem” w pamięci, bez dodatkowej otoczki.

Dlatego przy pracy z większymi danymi opłaca się pilnować, żeby jak najszybciej „zrzucić” je do postaci zwartych tablic/tensorów. Różnica między „mam 16 GB, nie da się” a „32 GB starcza z zapasem” często wynika bardziej z wyboru struktur niż z samej pojemności RAM.

Jak rozpoznać, że przydałoby się więcej RAM – w praktyce

Zanim pobiegniesz po kolejne kości, dobrze jest sprawdzić, czy faktycznie to RAM jest problemem. Kilka charakterystycznych objawów:

- Podczas wczytywania/łączenia danych wykorzystanie RAM szybciej dochodzi do 100% niż ukończy się operacja.

- Proces treningowy ML idzie „zrywami”: GPU chwilę pracuje, potem stoi bezczynnie, a dysk SSD „mieli” bez przerwy.

- System często „zamyka” aplikacje (szczególnie w macOS / Linux z OOM Killerem) lub Jupyter/IDE magicznie się restartuje przy bardziej pamięciożernym kroku.

Podglądaj podczas pracy zużycie pamięci (Monitor zasobów w Windows, htop/gnome-system-monitor w Linux). Jeśli często zbliżasz się do granicy i równocześnie rośnie zajętość pliku wymiany (swap), dołożenie RAM zwykle daje odczuwalny skok komfortu.

Dual channel, taktowanie i opóźnienia – co ma znaczenie przy ML

Dylemat „szybszy RAM vs więcej RAM” pojawia się niemal zawsze. Przy typowym domowym ML priorytety są dość klarowne:

- Najpierw pojemność – przeskok z 16 na 32 GB daje znacznie więcej niż z 3200 na 4000 MHz przy tej samej pojemności.

- Praca w dual channel – dwie kości (np. 2×16 GB) zamiast jednej (1×32 GB) poprawiają przepustowość, co wpływa na szybsze wczytywanie i przygotowanie batchy.

- Taktowanie i timingi – jeśli masz wybór między 2666 a 3200/3600 MHz, lepiej wziąć szybszy zestaw, ale nie dopłacać dużych pieniędzy za „super gamingowe” zestawy z minimalnie lepszymi CL.

W skrócie: RAM ma być wystarczająco szybki i sprawny, nie koniecznie „rekordowy”. Oszczędzone na ekstremalnych parametrach pieniądze lepiej dorzucić do większej pojemności lub lepszego GPU.

Rozbudowa RAM w istniejącym komputerze: pułapki mieszania kości

Jeśli modernizujesz obecny zestaw, naturalny odruch to „dokupię jeszcze dwie takie same kości”. To zwykle dobry plan, ale kilka rzeczy potrafi uprzykrzyć życie:

- Różne zestawy = różne kości – nawet jeśli mają te same parametry na pudełku, mogą mieć inne kości w środku. Płyta główna z reguły dostosuje całość do najwolniejszego modułu.

- Obsadzenie wszystkich slotów – 4×8 GB może obciążyć kontroler pamięci bardziej niż 2×16 GB. Niektóre płyty przy pełnym obsadzeniu obniżają maksymalne taktowanie.

- Stabilność XMP – po dodaniu kolejnych kości profil XMP (czyli podkręcone parametry pamięci) bywa niestabilny. Jeśli pojawiają się losowe błędy, czasem trzeba lekko obniżyć taktowanie RAM.

Przy domowej stacji ML najczęściej wygrywa konfiguracja 2×16 GB lub 2×32 GB zamiast „patchworku” z czterech różnych modułów. Mniej kombinacji = mniej potencjalnych problemów.

Dyski do ML: SSD, NVMe i organizacja danych

Rola pamięci masowej w przepływie pracy ML

Dyski nie przyspieszą samego mnożenia macierzy na GPU, ale decydują o tym, jak szybko:

- wczytasz surowe dane (obrazy, teksty, pliki audio),

- zrobisz preprocessing i zapiszesz „czyste” wersje zbiorów,

- załadujesz modele, checkpointy i wyniki eksperymentów.

Różnica między klasycznym HDD a szybkim SSD potrafi być dramatyczna. Jeżeli każda epoka treningu zaczyna się od 2–3 minut wczytywania datasetu, zniechęcenie przychodzi szybciej niż konwergencja modelu.

SSD vs HDD: gdzie który ma sens

W domowym komputerze pod ML sprawdza się prosta zasada: system i aktywne dane – na SSD, archiwum – na HDD (albo w chmurze).

- SSD (SATA lub NVMe):

- na nim trzymasz system operacyjny, środowiska (conda, Docker), biblioteki, projekty, aktualnie używane zbiory danych,

- idealne miejsce na katalog z datasetami, do których często sięgasz w trakcie eksperymentów,

- znacznie szybsze losowe odczyty – co widać przy loaderach ładujących małe pliki (np. pojedyncze obrazy) w locie.

- HDD:

- sprawdza się jako „magazyn”: stare modele, historyczne eksperymenty, zbiory, których nie używasz codziennie,

- dobry wybór, jeśli łączna objętość danych przekracza sensowny budżet na SSD,

- może służyć jako drugie (tańsze) miejsce backupu.

Jeśli budżet jest napięty i zastanawiasz się, czy lepiej dołożyć do większego SSD, czy do mocniejszego GPU – zwykle więcej korzyści da GPU. Minimalny komfort zapewnia jednak przynajmniej jeden porządny SSD jako dysk systemowo-projektowy.

NVMe vs SATA: czy „kosmiczne” prędkości mają znaczenie

NVMe na złączu M.2 potrafi oferować wielokrotnie wyższe prędkości sekwencyjnego odczytu niż klasyczny SSD SATA. W praktyce, przy typowym ML:

- różnica SATA SSD vs NVMe jest widoczna przy:

- kopiowaniu dużych plików (setki MB, GB),

- szybkim powielaniu/kompresji datasetów,

- rozpakowywaniu dużych archiwów (np. paczek z obrazami).

- mniej istotna przy:

- wczytywaniu pojedynczych, małych plików w losowej kolejności,

- pracy w Jupyterze, pisaniu kodu czy odpalaniu typowych skryptów.

Jeśli masz miejsce na płycie głównej, NVMe jako główny dysk „roboczy” to bardzo przyjemna opcja. Nie jest to jednak warunek konieczny do nauki ML – dobry SSD SATA również pozwoli pracować sprawnie.

Jak zorganizować dane na dyskach przy ML

Przy jednym projekcie wszystko jest proste, ale po kilku miesiącach pojawia się „ogród” folderów, różnych wersji datasetów i checkpointów. Porządek na dysku przekłada się na wygodę pracy:

- Oddziel system od danych – system + aplikacje na jednym SSD, katalog z datasetami i projektami na innym (jeśli to możliwe). Aktualizacje systemu czy reinstalacja nie naruszą twoich danych.

- Wydziel folder „datasets” – trzymając wszystkie zbiory w jednym miejscu, łatwiej je podmontować do Dockerów i zarządzać backupem.

- Preprocessing zapisuj jako osobne wersje – np.

raw/,processed/,features/. Unikniesz nadpisywania oryginałów i szybciej odtworzysz ścieżkę, jeśli coś pójdzie nie tak.

Na poziomie kodu dobrze jest używać ścieżek względnych i prostych zmiennych konfiguracyjnych (np. DATA_DIR w pliku .env). Dzięki temu łatwiej przeniesiesz projekt między komputerami i dyskami.

Pojemność dysków: ile miejsca realnie zabierają dane i modele

Planując pojemność, łatwo niedoszacować. Kilka praktycznych punktów odniesienia:

- Modele – checkpointy dużych sieci (szczególnie transformerów) potrafią mieć od kilkuset MB do kilku GB za sztukę. Kilka wersji + backup i nagle robi się kilkadziesiąt GB.

- Obrazy – paczka kilkudziesięciu tysięcy zdjęć w wysokiej rozdzielczości szybko dobija do dziesiątek GB, szczególnie jeśli masz i oryginały, i wersje przetworzone.

- Logi i wyniki eksperymentów – TensorBoard, wandb, CSV z metrykami – to z początku „zmierzch płyt głównych” (czyli mało), ale po roku kilku aktywnych projektów potrafią łącznie zająć parę gigabajtów.

Na start sensowna konfiguracja to: SSD 500 GB – 1 TB na system i aktywne projekty + ewentualnie dodatkowy HDD 1–4 TB na archiwum. Jeśli wiesz, że będziesz trzymać duże zbiory wideo lub wiele wersji datasetów, lepiej od razu celować w minimum 1 TB SSD.

Wydajność I/O a bottleneck w treningu

Przy dobrze skonfigurowanym pipeline GPU powinno mieć możliwie mało „przerw na kawę” – czyli na czekanie, aż dane dojadą z dysku i zostaną przetworzone. Kilka sygnałów, że to I/O jest twoim wąskim gardłem:

- GPU Monitoring pokazuje niskie wykorzystanie GPU (np. 20–40%), mimo że masz mały model i niewielki batch size.

- Podczas treningu dysk SSD ma bardzo wysokie zużycie (bliskie 100%), a procesor jest średnio obciążony.

- Zwiększenie liczby workerów w DataLoaderze (PyTorch) znacząco przyspiesza trening, ale jednocześnie mocno podbija aktywność dysku.

W takiej sytuacji może pomóc zarówno szybszy dysk, jak i mądrzejszy preprocessing: łączenie małych plików w większe pakiety (np. TFRecordy, LMDB, HDF5), cache’owanie części danych w RAM albo zapis przetworzonych wersji zbioru, żeby nie liczyć tych samych transformacji w kółko.

Backup i bezpieczeństwo danych projektowych

Sprzęt to jedno, ale utrata kilku miesięcy pracy przez padnięty dysk potrafi zaboleć bardziej niż brak dodatkowych rdzeni CUDA. Nie trzeba od razu budować rozbudowanego systemu kopii zapasowych, ale proste nawyki robią ogromną różnicę:

- Repozytorium kodu (Git) – kod, konfiguracje i drobne pliki tekstowe trzymaj w zdalnym repo (GitHub, GitLab, Bitbucket). To podstawa.

- Ważne modele i notebooki – co jakiś czas kopiuj najważniejsze checkpointy i analizę wyników na drugi fizyczny dysk lub do chmury (np. zwykły dysk sieciowy, Syncthing, Dropbox, Google Drive).

- Zbiory surowe – jeśli dane pochodzą z zewnętrznego źródła, dobrze mieć zapisane linki/skrypty pobierające. Ściągnięcie danych jeszcze raz bywa prostsze niż przechowywanie wielu kopii, ale nie zawsze (szczególnie gdy to dane własne).

Dobrym kompromisem jest prosty, automatyczny backup nocny najważniejszych folderów (projekty, modele, dokumentacja) na drugi dysk w komputerze lub na domowego NAS-a. Jednorazowa konfiguracja, a stres przy pierwszym „crashu” jest dużo mniejszy.

Jak zbalansować GPU, RAM i dyski pod własne scenariusze ML

Scenariusz: nauka ML i małe projekty na jednym GPU

Jeśli dopiero wchodzisz w temat, nie trzeba od razu budować „potwora”. Dla osoby uczącej się, robiącej kursy, Kaggle i małe projekty, rozsądny zestaw to:

- GPU: RTX z 8–12 GB VRAM (np. xx60/xx70 z ostatnich generacji),

- RAM: 32 GB, w dwóch kościach,

- Dysk: SSD 1 TB (SATA lub NVMe) jako główny, ewentualnie HDD 1–2 TB jako magazyn.

Taki sprzęt pozwoli bez frustracji przejść przez większość materiałów edukacyjnych, robić projekty z CV/NLP na rozsądnych podzbiorach i eksperymentować z własnymi modelami. Granicą będzie raczej VRAM i czas treningu niż brak miejsca na dysku czy przepełniony RAM.

Scenariusz: ambitne projekty CV/NLP i praca z większymi danymi

Gdy zaczynasz grzebać w większych modelach wizji lub języka, VRAM i RAM stają się dużo bardziej odczuwalne. Przykładowy punkt odniesienia:

- GPU: karta z 12–24 GB VRAM (RTX 4070/4070 Ti, 4080, używane 3090/4090 itp.),

Najczęściej zadawane pytania (FAQ)

Jaki komputer do machine learning w domu na start – co jest absolutnym minimum?

Do nauki klasycznego ML i pierwszych sieci w PyTorch/TensorFlow wystarczy sensowny procesor, 16–32 GB RAM i szybki dysk SSD. GPU nie jest konieczne, jeśli robisz głównie scikit‑learn, XGBoost na małych zbiorach i proste przykłady z kursów.

Jeśli od początku chcesz bawić się deep learningiem (obrazy, proste modele NLP), celuj w kartę graficzną z min. 8 GB VRAM, 32 GB RAM i SSD NVMe co najmniej 1 TB. Taki zestaw pozwoli wygodnie uruchamiać większość przykładów z popularnych tutoriali i robić pierwsze własne projekty.

Ile VRAM potrzebuję do Stable Diffusion i modeli generatywnych w domu?

Do komfortowej pracy ze Stable Diffusion dobrze mieć przynajmniej 12 GB VRAM. Na 8 GB da się coś uruchomić z mniejszym rozmiarem batcha, niższą rozdzielczością lub mocniejszą optymalizacją pamięci, ale częściej trzeba kombinować z ustawieniami.

Jeśli planujesz trenowanie własnych stylów, LoRA, większe modele czy długie sesje generowania w wysokiej rozdzielczości, sensownym punktem docelowym jest 12–24 GB VRAM. Powyżej 24 GB to już sprzęt pod bardziej zaawansowane eksperymenty, a nie tylko hobbystyczne użycie.

Jaka karta graficzna do lokalnych LLM (LLaMA, Mistral) i czy 8 GB VRAM wystarczy?

Do uruchamiania małych, skompresowanych modeli LLM w trybie tylko do odpytywania (inference) 8 GB VRAM może wystarczyć, ale szybko poczujesz ograniczenia — zwłaszcza przy większej liczbie parametrów i dłuższym kontekście. Będzie działać, ale często „na styk”.

Do sensownych eksperymentów z LLM w domu, w tym LoRA i testowania różnych kwantyzacji, celuj w 24 GB VRAM lub więcej. Przy mniejszych modelach i bez fine‑tuningu można zejść do 12–16 GB, ale wtedy trzeba ostrożniej dobierać rozmiar i typ modelu.

Czy do klasycznego machine learning (scikit‑learn, XGBoost) potrzebuję mocnego GPU?

Nie. Klasyczne ML (drzewa, lasy, gradient boosting, regresje, SVM) w większości i tak liczy się na CPU i korzysta głównie z RAM oraz szybkiego dysku. Dobre, wielordzeniowe CPU plus 32 GB RAM zrobi tu więcej roboty niż droga karta graficzna.

GPU może przyspieszyć niektóre biblioteki (np. XGBoost z CUDA, cuML), ale jest to miły bonus, a nie wymóg. Jeśli Twoja praca to przede wszystkim pandas, scikit‑learn i XGBoost na tabelkach, lepiej dołożyć do RAM i SSD niż do „potwora” na PCIe.

CUDA vs ROCm vs Intel – którą platformę wybrać do domowego ML?

Dla większości osób najbezpieczniejszym wyborem jest NVIDIA z CUDA. Ekosystem jest dopracowany, PyTorch i TensorFlow mają stabilne wersje, a większość tutoriali i gotowych dockerów jest pisana właśnie pod CUDA. To oznacza mniej dziwnych błędów i szukanek po forach.

AMD z ROCm i GPU Intela (oneAPI) są ciekawą alternatywą, ale wymagają więcej cierpliwości: wsparcie bywa zależne od konkretnej karty, systemu i wersji sterowników, a pod Windows komplikacji jest zwykle więcej. Jeśli nie lubisz „rzeźby”, pierwsza domowa maszyna pod ML prawie zawsze wychodzi korzystniej na NVIDIA.

Ile RAM-u potrzebuję do domowego ML i czy 16 GB jeszcze ma sens?

16 GB RAM wystarczy na sam start nauki, proste kursy online i małe projekty w notatnikach, ale przy większych datasetach i kilku środowiskach Condy jednocześnie bardzo szybko poczujesz ścianę. System zacznie swapować na dysk, a każda operacja będzie się dłużyć.

Rozsądnym minimum pod ML w domu jest dziś 32 GB RAM. Jeśli planujesz pracę z większymi zbiorami danych, kilkoma kontenerami Dockera, Stable Diffusion czy lokalnymi LLM, 64 GB daje znacznie większy komfort i pozwala GPU pracować bez ciągłego „dopychania” danych z dysku.

Trenować modele w domu czy w chmurze – co się bardziej opłaca?

Małe modele, nauka podstaw, prototypy i fine‑tuning LoRA spokojnie ogarniesz na domowym sprzęcie, szczególnie jeśli masz sensowne GPU i dużo RAM. To wygodne, bo możesz eksperymentować kiedy chcesz i nie liczysz minut w chmurze.

Dla dużych modeli (pełne Stable Diffusion od zera, spore transformatory NLP, poważne eksperymenty z LLM) domowy PC szybko staje się wąskim gardłem – ogranicza Cię VRAM, czas treningu i rachunek za prąd. Tu często taniej i szybciej wychodzi wykupienie kilku godzin w chmurze, a lokalnie trzymanie środowiska do inference i mniejszych testów.