Kontekst 2026: od mody na AI do nowego standardu pracy programisty

Pięć lat ewolucji: od podpowiedzi linii do „AI-native IDE”

Rok 2026 to moment, w którym AI w IDE przestało być ciekawostką, a stało się elementem minimum higieny pracy developerskiej. W 2021–2022 Github Copilot pokazał, że model językowy potrafi uzupełniać kod na poziomie pojedynczych linii. W 2023–2024 pojawiły się pierwsze dojrzałe asystenty multi‑pliku, rozumiejące większy kontekst repozytorium. Od 2024 widać było przesunięcie w stronę narzędzi typu Cursor – gdzie całe IDE jest zbudowane wokół AI, a nie odwrotnie.

W 2026 typowy projekt komercyjny korzysta z kilku warstw automatyzacji: od prostego autocomplete, przez czat kontekstowy nad repozytorium, aż po półautomatyczne refaktoryzacje i generowanie testów. Dyskusja „czy używać AI do kodu” praktycznie wygasła. Główne pytania dotyczą tego, jak kontrolować jakość, jak pilnować prywatności i jak zorganizować procesy, żeby zysk z AI nie został zjedzony przez poprawianie błędów modelu.

Jeśli w 2026 zespół nie korzysta z żadnego ekosystemu AI (Github Copilot, Codeium, Cursor lub alternatyw), to jest to raczej sygnał ostrzegawczy o problemach kulturowych lub regulacyjnych niż świadomy wybór technologiczny.

AI w procesach: od pojedynczego developera do całego SDLC

Asystenci kodu weszli dziś głęboko w Software Development Life Cycle. Obecność AI w pracy programisty nie ogranicza się do podpowiadania kodu w trakcie pisania pliku. Typowe użycia w 2026 to:

- Code review wspomagane AI – wstępna analiza pull requestów, wykrywanie typowych antywzorców, podpowiadanie refaktoryzacji jeszcze przed spojrzeniem seniora.

- Generowanie i utrzymanie testów – dopisywanie brakujących testów jednostkowych, testów kontraktowych i snapshotów przy każdej większej zmianie.

- Migracje frameworków i bibliotek – przepisywanie komponentów z Reacta na Svelte, z JUnit 4 na JUnit 5, z REST na GraphQL, z zachowaniem logiki biznesowej.

- Analiza regresji i bug‑fix – wyjaśnienie stack trace, zaproponowanie „minimal reproducible example” i szkicu poprawki.

- Dokumentacja i onboarding – automatyczne generowanie docstringów, README, diagramów zależności oraz odpowiedzi na pytania osób, które dopiero wchodzą w projekt.

Jeśli AI uczestniczy tylko w pisaniu pojedynczych funkcji, a nie w całym cyklu zmian (review, testy, migracje), to znaczy, że ekosystem nie jest jeszcze właściwie wdrożony lub zespół wykorzystuje go w bardzo ograniczonym zakresie.

Nowe oczekiwania wobec programisty: mniej „pisania”, więcej audytu jakości

Wraz z dojrzewaniem Github Copilot, Codeium i Cursor zmienił się profil kompetencji, których szuka rynek. Coraz mniej liczy się szybkość klepania kodu, a coraz bardziej:

- projektowanie architektury i jasne definiowanie kontraktów między modułami,

- krytyczne myślenie – umiejętność rozpoznawania, kiedy sugestia AI jest poprawna, a kiedy ryzykowna,

- audyt jakości – przeglądanie i korygowanie generowanego kodu pod kątem bezpieczeństwa, wydajności i stylu,

- formułowanie precyzyjnych poleceń – tzw. „prompt engineering” przetłumaczony na realia pracy w IDE.

To przesunięcie wymusza nową definicję „doświadczonego developera”: senior rzadziej pisze od zera całe moduły, częściej ustawia kierunek, projektuje strukturę i weryfikuje propozycje, które produkuje Github Copilot, Codeium czy Cursor. Jeśli ktoś próbuje 1:1 przepisywać podpowiedzi AI bez refleksji, szybko wpada w spiralę długów technicznych.

Typowy stos narzędzi w 2026: kiedy Copilot, kiedy Codeium, kiedy Cursor

W wielu organizacjach pojawił się stack AI‑tools, a nie pojedyncze rozwiązanie. Przykładowy scenariusz:

- Github Copilot jako baseline do szybkich podpowiedzi inline i prostych zadań w VS Code lub JetBrains.

- Codeium tam, gdzie kluczowa jest prywatność kodu, praca on‑prem albo wsparcie wielu IDE w jednym standardzie.

- Cursor jako specjalistyczne środowisko do intensywnej pracy nad jedną codebase: refaktoryzacje, migracje, analiza złożonych zależności.

W mniejszych zespołach często wygrywa jedno narzędzie (zwykle Copilot lub Codeium), ale i tak pojawia się drugi produkt jako „plan B” dla specyficznych use case’ów, jak duże przepisywanie legacy. Sygnał ostrzegawczy pojawia się, gdy firma dobiera narzędzia wyłącznie po marketingu lub „bo ktoś tak ma”, bez przetestowania na własnym stacku.

Profil trzech ekosystemów: Github Copilot, Codeium, Cursor – geneza i filozofia

Github Copilot: plugin, który urósł do klasy korporacyjnego ekosystemu

Github Copilot startował jako rozszerzenie do VS Code z modelami OpenAI generującymi krótkie podpowiedzi. W 2026 to pełny ekosystem obejmujący:

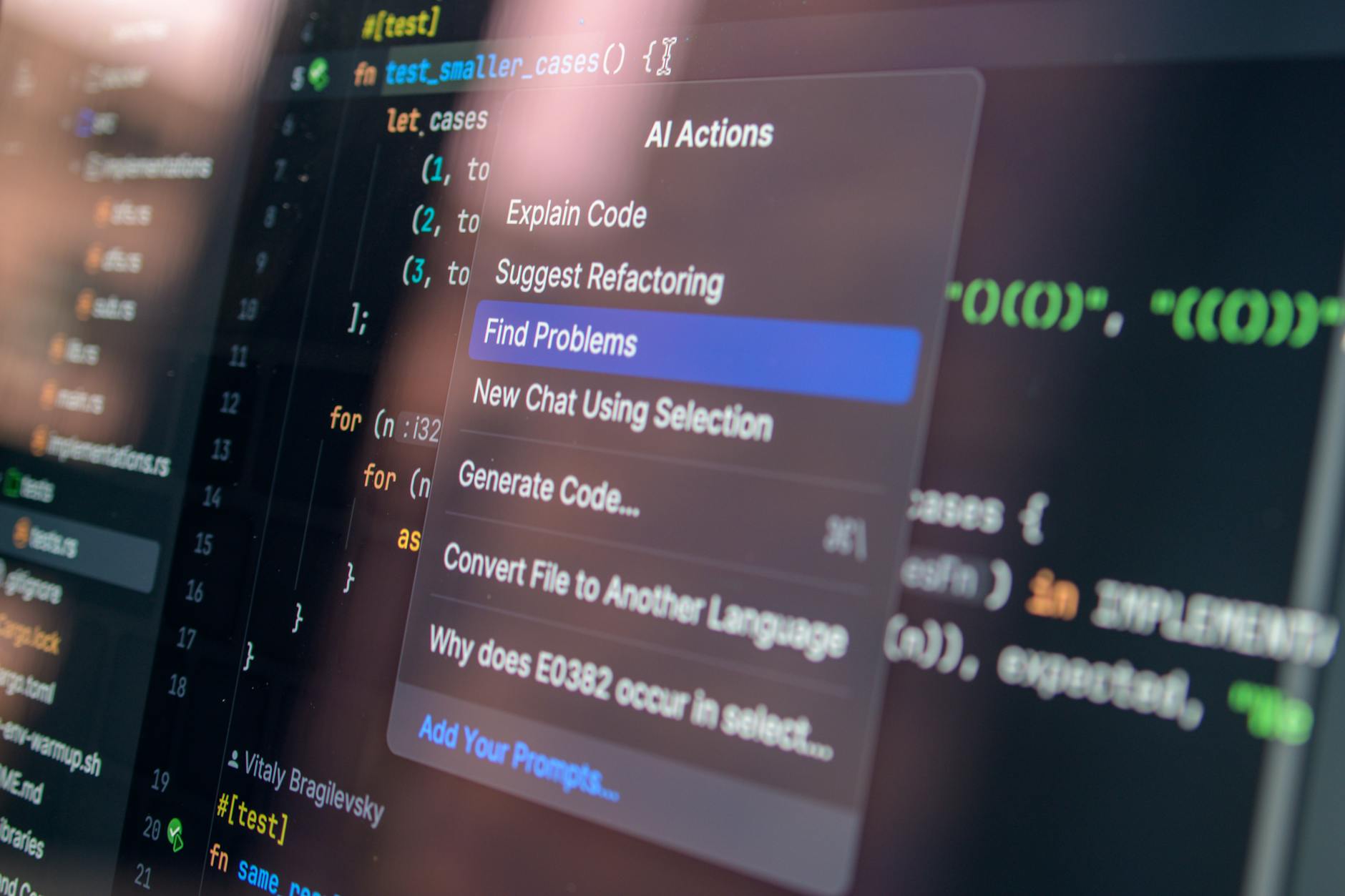

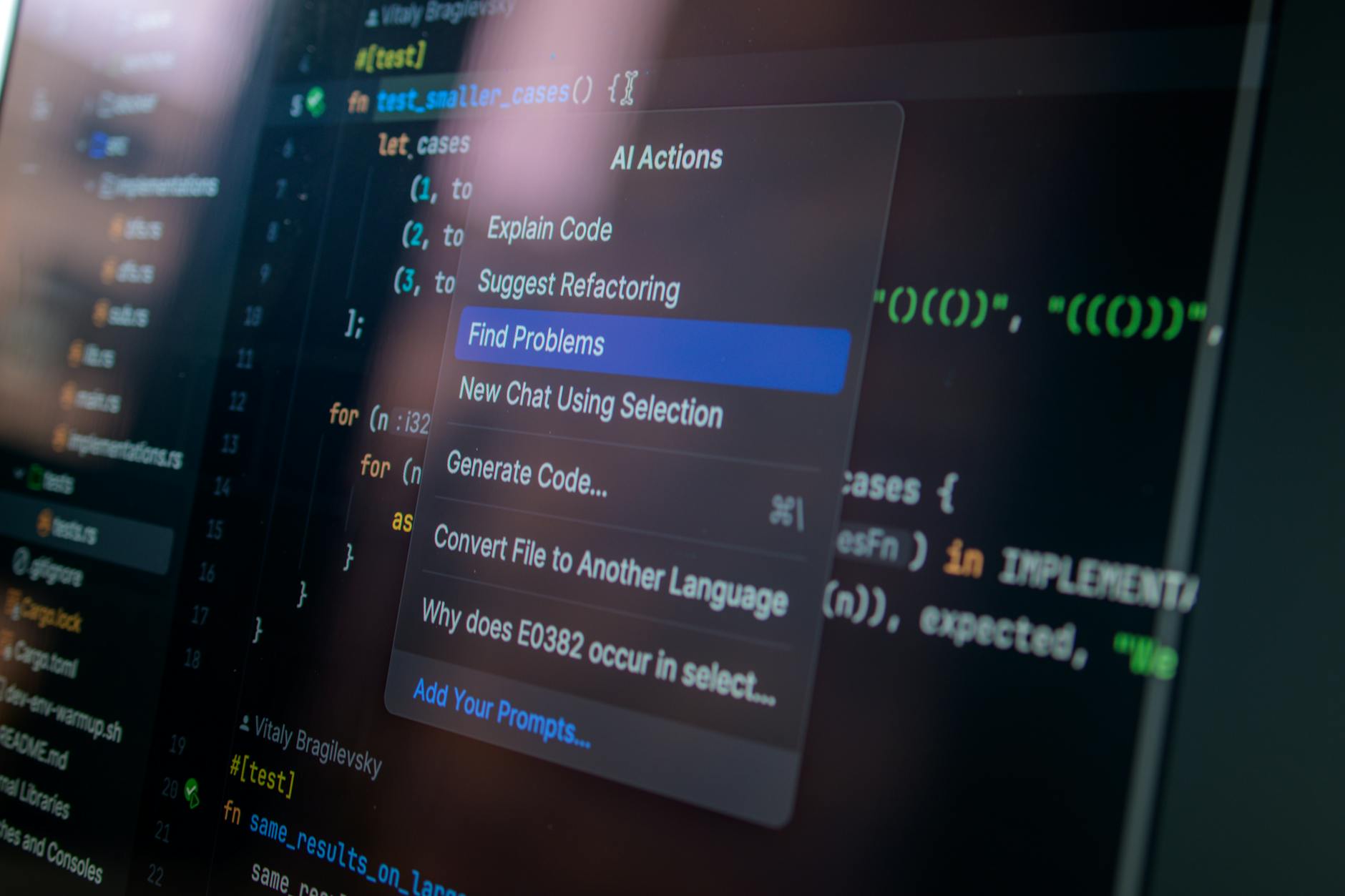

- Copilot w IDE – inline suggestions, chat, komendy na zaznaczonym kodzie („explain”, „refactor”, „add tests”).

- Github Copilot Chat w przeglądarce – rozmowa na temat repozytorium, pull requestów, issue i dokumentacji.

- Copilot Enterprise – personalizowane modele, integracja z prywatną dokumentacją firmy, kontrola zgodności i zgodność z politykami bezpieczeństwa.

Mocną stroną Copilota jest bliskość do GitHuba. Kontekst repo, historie commitów, PR‑y, Actions – wszystko to może być wykorzystane przez AI. To ułatwia wdrożenie w firmach, które i tak żyją w ekosystemie GitHub. Cena jest zwykle rozliczana per seat, co upraszcza budżetowanie, ale przy dużych zespołach wymaga jasnej kalkulacji ROI.

Jeżeli zespół korzysta z GitHuba jako głównej platformy repozytoriów i CI/CD, Copilot jest naturalnym pierwszym kandydatem – nawet jeśli nie ma wszystkich funkcji IDE‑first znanych z Cursora.

Codeium: nacisk na prywatność, wydajność i szerokie wsparcie IDE

Codeium wyróżnia się od początku silnym akcentem na prywatność i elastyczne wdrożenia. Zamiast budować własny hosting kodu, zespół Codeium skoncentrował się na:

- obsłudze wielu IDE (VS Code, JetBrains, Vim/Neovim, web IDE),

- możliwości uruchomienia on‑prem lub w odseparowanych środowiskach chmurowych,

- własnych, zoptymalizowanych modelach wyspecjalizowanych w kodzie,

- alternatywnym modelu cenowym – bardzo atrakcyjnym dla indywidualnych developerów i małych zespołów.

Dla organizacji z silnymi wymaganiami compliance (bankowość, medtech, software house’y pracujące na kodzie klientów) Codeium jest często pierwszym wyborem, bo ułatwia spełnienie wymogów prawnych dotyczących lokalizacji danych i audytowalności. Dodatkowo integracja z JetBrains bywa bardziej dopracowana niż w konkurencyjnych rozwiązaniach.

Jeśli główny punkt kontrolny przy wyborze narzędzia to „kod nie może opuścić naszej infrastruktury”, Codeium zwykle wygrywa z Copilotem i Cursorem na etapie wstępnego audytu.

Cursor: AI‑native IDE z AI jako centralnym silnikiem pracy

Cursor reprezentuje podejście IDE‑first. Zamiast rozszerzać istniejące środowisko, twórcy zbudowali nowy edytor oparty o silnik VS Code, ale przystosowany do pracy z AI jako pierwszoplanowym elementem. Kluczowe elementy filozofii Cursor:

- codebase chat – możliwość rozmowy z AI o całym projekcie, nie tylko o aktualnie otwartym pliku,

- automatyczne refaktoryzacje – operacje na wielu plikach, z uwzględnieniem zależności i stylu repo,

- rozszerzony context window – modele otrzymują większy wycinek projektu, co ogranicza halucynacje i pomyłki,

- ścisła integracja z systemem kontroli wersji – łatwe porównywanie propozycji AI z aktualnym stanem git.

Cursor korzysta z różnych modeli (m.in. GPT, Claude), często oferując hybrydowy wybór w zależności od zadania: jeden model do generowania, inny do refaktoryzacji lub analizy. To daje elastyczność kosztem nieco większej złożoności konfiguracji – szczególnie przy wielu developerach.

Jeśli zespół jest gotowy przyjąć nowe IDE i skupić się na jednym dużym monorepo lub paru kluczowych codebase’ach, Cursor może stać się centralnym narzędziem pracy, redukując potrzebę dodatkowych pluginów.

„AI jako plugin” kontra „AI jako silnik pracy”

Github Copilot i Codeium wchodzą w istniejące IDE jako dodatkowa warstwa. Developer nadal postrzega VS Code / IntelliJ / Neovim jako główny warsztat, a AI jako pomocnika. W Cursorze AI jest rdzeniem – większość nowych funkcji edytora projektowana jest z myślą o interakcjach człowiek‑AI.

Konsekwencje dla zespołu:

- w przypadku Copilot/Codeium zmiana jest łagodniejsza, bo workflow IDE pozostaje ten sam,

- Cursor wymaga większej transformacji na poziomie nawyków, ale w zamian odblokowuje scenariusze, których pluginy nie realizują tak płynnie (np. masowe modyfikacje projektu z natychmiastowym wsparciem AI).

Jeżeli zespół oczekuje minimalnej zmiany środowiska, Copilot lub Codeium będą bezpieczniejszym punktem startu; jeśli celem jest skokowy wzrost velocity na jednej kluczowej codebase, Cursor staje się naturalnym kandydatem.

Modele, kontekst i jakość odpowiedzi: jak mierzyć „inteligencję” ekosystemu

Jakie modele stoją za Github Copilot, Codeium i Cursorem w 2026

W 2026 roku wszystkie trzy ekosystemy korzystają z modeli generatywnych nowej generacji. Schemat jest podobny, ale implementacja różna:

- Github Copilot – opiera się głównie na rodzinie GPT‑4.x/5 dostosowanej do zadań kodowych, z dodatkowymi warstwami fine‑tuningowymi na kodzie z publicznych repo oraz danych GitHub (z zachowaniem zasad licencyjnych).

- Codeium – korzysta z własnych, wyspecjalizowanych modeli trenowanych na kodzie, dodatkowo oferując konfigurację zewnętrznych modeli w wydaniach enterprise oraz opcje on‑prem.

- Cursor – stosuje hybrydę modeli (OpenAI, Anthropic, inne), często dobierając model do zadania i wielkości kontekstu, co skutkuje lepszą adaptacją do złożonych operacji na codebase.

Sam wybór modelu to tylko część układanki. Kluczowe jest to, jak narzędzie buduje kontekst – czyli jakie fragmenty kodu i metadanych przekazuje do modelu, aby odpowiedź była dopasowana do konkretnego projektu.

Kontekst: pliki otwarte, cała codebase, repo z GitHuba

Różnice w sposobie budowania kontekstu są jedną z głównych osi porównania. Ogólnie:

- Copilot w trybie podstawowym korzysta z otwartych plików i okolicznego kodu, coraz częściej jednak – zwłaszcza w wariantach enterprise – wciąga w kontekst również pliki powiązane i dane z repozytorium GitHub.

- Codeium stosuje lokalne indeksowanie codebase; indeksy te pozwalają na zadawanie pytań do całego projektu i generowanie zmian z uwzględnieniem wielu plików.

- Cursor idzie najdalej: buduje rozbudowany indeks projektu, a pytania do AI są automatycznie „wzbogacane” o relewantne pliki, historię zmian, a często też wyniki grepa / LSP (Language Server Protocol).

Im lepiej narzędzie buduje kontekst, tym mniejsze ryzyko halucynacji i nietrafionych sugestii. Jeżeli asystent regularnie ignoruje istniejące funkcje lub powiela logikę, zamiast wywołać gotowy helper, jest to jasny sygnał, że mechanizm budowania kontekstu jest niedostosowany albo źle skonfigurowany.

Sygnały ostrzegawcze: halucynacje, zmyślone API, nieznajomość frameworka

Bez względu na narzędzie, modele pozostają probabilistyczne. Z punktu widzenia audytu jakości trzeba szukać kilku typowych sygnałów ostrzegawczych:

- Zmyślone biblioteki lub funkcje – AI proponuje importy, które nie istnieją, lub metody, których nigdy nie było w danym API.

- Niedostosowanie do frameworka – generowanie kodu w stylu starej wersji frameworka (np. React class components w projekcie nastawionym na hooks).

- Ignorowanie istniejących helperów – powielanie logiki, mimo że w projekcie są do tego gotowe funkcje lub klasy.

Jak samodzielnie ocenić „inteligencję” asystenta: praktyczny protokół testowy

Zamiast wierzyć w benchmarki marketingowe, lepiej przeprowadzić krótki, ustandaryzowany test na własnej codebase. Minimalny protokół, który odsłania różnice między Copilotem, Codeium i Cursorem:

- Scenariusz 1 – dopisanie funkcji w istniejącym module: poproś AI o dodanie brakującej walidacji lub nowej gałęzi logiki w pliku z rozbudowaną funkcją domenową. Kryteria:

- czy AI zachowuje styl i konwencje pliku (naming, error handling, logging),

- czy używa istniejących helperów zamiast pisać wszystko od zera,

- ile tur poprawy jest potrzebnych, by kod nadawał się do PR.

- Scenariusz 2 – zmiana przekrojowa: poproś o migrację jednego konceptu (np. typ wyliczeniowy, nowy enum statusu) w kilku plikach. Kryteria:

- czy narzędzie samo identyfikuje wszystkie miejsca użycia,

- jak radzi sobie z aktualizacją testów i dokumentacji,

- czy generuje spójne nazwy i komunikaty błędów.

- Scenariusz 3 – bugfix na produkcyjnym błędzie: wklej realny stack trace, logi oraz fragmenty kodu. Kryteria:

- czy AI poprawnie diagnozuje źródło problemu,

- czy proponuje rozwiązanie uwzględniające ograniczenia architektury,

- czy uwzględnia edge case’y widoczne w logach.

- Scenariusz 4 – zielone pole (greenfield): zdefiniuj prostą funkcję biznesową opisem tekstowym. Kryteria:

- czy AI proponuje architekturę zgodną ze stylem repo (np. warstwy, patterny),

- czy generuje sensowne testy jednostkowe/integracyjne,

- jak wygląda czytelność i ilość „magii” w wygenerowanym kodzie.

Jeżeli narzędzie regularnie „zapomina” o konwencjach projektowych lub wymaga kilkunastu iteracji na prosty fix, sygnał jest jasny: kontekst jest zbyt płytki, a modele niedopasowane do waszego stylu pracy. Jeżeli natomiast wystarczy jedna–dwie iteracje do kodu gotowego na code review, oznacza to, że ekosystem AI jest dobrze zestrojony z projektem.

Metryki jakościowe i ilościowe: co mierzyć poza „wow, to działa”

Efekt „pierwszego wrażenia” łatwo fałszuje obraz – generowanie kilkudziesięciu linii kodu wygląda efektownie, nawet jeśli połowa jest zbędna. Przy audycie ekosystemu AI przydaje się prosty zestaw metryk:

- Precision vs. noise – stosunek użytecznych podpowiedzi do wszystkich wygenerowanych fragmentów:

- mierzalne subiektywnie: w ciągu tygodnia spisz sytuacje, gdy usunąłeś podpowiedź jako bezużyteczną,

- narzędzia IDE (szczególnie w 2026) często raportują odsetek zaakceptowanych sugestii vs. wyświetlonych.

- Defect rate – ile błędów wprowadzają sugestie AI:

- bugi wykryte przez testy automatyczne po merge’u zmian generowanych przez AI,

- regresje zgłaszane przez QA powiązane z commitami, gdzie AI wygenerowała główną część kodu.

- Czas od problemu do PR – czy interakcja z AI skraca realne lead time:

- czas od stworzenia ticketu do gotowego PR w typowych zadaniach,

- liczba tur review potrzebnych do akceptacji (czy AI generuje kod bliżej standardu „production ready”).

- Dług techniczny generowany przez AI – trudniejsze do policzenia, ale kluczowe:

- ilość „tymczasowych” rozwiązań, które zostają na stałe,

- fragmenty kodu, których nikt nie rozumie po tygodniu, bo były bezrefleksyjnie przyjęte z AI.

Jeżeli widzisz wzrost prędkości kosztem lawiny regresji, narzędzie pełni rolę generatora długu technicznego. Jeżeli liczba poprawek na code review spada, a defect rate pozostaje stabilny lub maleje, ekosystem AI jest wspierający, a nie destrukcyjny.

Integracje z IDE i workflow: gdzie AI naprawdę „żyje” w ciągu dnia

Copilot: przewaga w ekosystemie GitHub i „lekki” onboarding

Copilot w 2026 roku jest głęboko zakorzeniony w GitHubie, ale również w głównych IDE. Integracja przebiega na kilku warstwach:

- VS Code / JetBrains / Visual Studio – auto‑uzupełnianie, inline chat, komendy na zaznaczeniu; konfiguracja polityk workspace’ów (np. wykluczenia folderów, tryby prywatności).

- GitHub.com – Copilot w oknie pull requestu (sugestie zmian, opis PR, streszczenie diffów), wsparcie przy tworzeniu issue (szablony, redefinicja AC w języku programisty).

- GitHub Actions – generowanie workflowów CI/CD, refaktoryzacja istniejących pipeline’ów, propozycje optymalizacji cache i matrix build.

Z punktu widzenia audytora kluczowe są punkty kontrolne:

- czy konfiguracja Copilota jest spójna z polityką repo (np. wyłączona dla forków zewnętrznych, ograniczona w krytycznych repo),

- czy zespół rozumie, że sugestie w PR nie są równoważne code review, tylko wsparciem – inaczej łatwo przesunąć odpowiedzialność z ludzi na narzędzie,

- czy integracje z Actions nie generują wokół CI „magicznego” YAML‑a, którego nikt nie potrafi samodzielnie utrzymać.

Jeżeli główny rytm pracy to GitHub Flow (branch → PR → review → merge) i VS Code/JetBrains, Copilot wchodzi niemal niezauważenie – wymaga jedynie dojrzałości procesowej, żeby nie zamienił code review w formalność przyklepywaną na podstawie komentarzy AI.

Codeium: integracje „wszędzie tam, gdzie jest kod”

Codeium celuje w szeroką, ale technicznie spójną integrację. W 2026 obejmuje:

- JetBrains i IntelliJ‑opodobne IDE – komplet funkcji (inline, chat, codebase search) z naciskiem na projekty JVM, C++ i data‑science,

- Vim/Neovim – lekki klient z obsługą podpowiedzi w trybie insert i dedykowanymi komendami na zaznaczeniu (często kluczowe dla zespołów DevOps/SRE),

- web IDE i własne portale deweloperskie – integracja przez API, co pozwala osadzić AI w narzędziach wewnętrznych (np. edytor DSL, konfiguratory pipeline’ów).

Istotnym wyróżnikiem jest elastyczność wdrożeń:

- instancje on‑prem z lokalnym indeksowaniem kodu,

- prywatne endpointy w VPC,

- integracja z korporacyjnym SSO i systemami uprawnień.

Przy audycie integracji Codeium warto przejść przez kilka pytań kontrolnych:

- czy indeksy codebase są wersjonowane i odświeżane przy większych refaktoryzacjach,

- czy zasady dostępu do projektów w Codeium odzwierciedlają polityki repo (brak „nadmiarowego” wglądu juniorów do krytycznych serwisów),

- czy ktoś odpowiada za utrzymanie infrastruktury on‑prem (monitoring, bezpieczeństwo, backup indeksów).

Jeżeli organizacja posiada mieszankę IDE, własne narzędzia webowe i restrykcyjne procedury bezpieczeństwa, Codeium zwykle lepiej wpasowuje się w zastaną architekturę niż Copilot czy Cursor – pod warunkiem, że ktoś realnie zarządza jego infrastrukturą.

Cursor: workflow zbudowany wokół codebase chat i operacji wieloplikowych

Cursor zmienia codzienny rytm pracy: zamiast „edytuję plik, czasem pytam AI”, model staje się raczej „rozmawiam z projektem, edytor wykonuje zmiany”. Główne punkty integracji:

- codebase chat w panelu bocznym – konwersacja z AI z możliwością natychmiastowego wprowadzania sugerowanych zmian w wielu plikach; akceptacja odbywa się plik po pliku lub chunk po chunku.

- komendy typu „edit” na zaznaczeniu – sformułowania w stylu „przerób na async/await”, „usuń duplikaty logiki z X.ts”; Cursor sam dobiera model i kontekst.

- podgląd diffów – każda większa operacja AI kończy się zestawieniem różnic, co wymusza na programiście rzetelny przegląd przed commitem.

Z perspektywy audytu warto obserwować kilka obszarów:

- czy zespół nie zaczyna traktować codebase chat jako jedynego źródła prawdy (zamiast dokumentacji i ADR),

- czy zmiany wieloplikowe mają jasne opisy commitów, a nie tylko „refactor by AI”,

- czy nie powstaje zbyt wiele „ukrytych” decyzji architektonicznych podejmowanych w dialogu z AI bez zapisania uzasadnienia.

Jeżeli projekt jest duży i słabo udokumentowany, Cursor może stać się nieformalnym „przewodnikiem” po codebase – co jest plusem dla szybkości, ale minusem, jeśli decyzje techniczne znikają w historii czatu, a nie trafiają do architektury referencyjnej.

Typowe punkty tarcia w integracji AI z workflow zespołu

Niezależnie od wybranego ekosystemu, pewne problemy powtarzają się w audytach:

- Brak wspólnych zasad użycia AI – każdy developer posiada własny styl korzystania z narzędzia; efektem są rozbieżne standardy jakości i testów.

- „Shadow coding” – fragmenty generowane przez AI nie są oficjalnie oznaczane, trudno więc wrócić do nich przy przeglądach długu technicznego.

- Nadmierne zaufanie do AI w krytycznych modułach – szczególnie w obszarach bezpieczeństwa, kryptografii, compliance.

Prosty minimalny standard, który ogranicza te napięcia:

- spisany kodeks użycia AI w repo (np. CONTRIBUTING.md) – co wolno generować, a jakie moduły wymagają ręcznej implementacji,

- obowiązek testów dla istotnych zmian AI‑generated oraz explicite zaznaczanie w opisie PR, że znaczna część kodu powstała z pomocą asystenta,

- zasada, że przynajmniej jeden reviewer analizuje krytyczne zmiany bez sugerowanych komentarzy AI, zanim ich użyje.

Jeśli AI jest formalnie wpisane w Definition of Done (np. „zmiany wygenerowane z AI muszą przejść dodatkowy zestaw testów”), narzędzie przestaje działać „w szarej strefie” i można realnie monitorować jego wpływ na jakość.

Funkcje core: generowanie kodu, uzupełnianie, refaktoryzacja, testy

Generowanie kodu „od zera”: kiedy pomaga, a kiedy szkodzi

W 2026 roku wszystkie trzy ekosystemy radzą sobie dobrze z generowaniem boilerplate’u, prostych endpointów czy warstw integracyjnych. Różnice zaczynają się przy złożonej logice biznesowej.

- Copilot:

- mocny w standardowych patternach webowych (REST, GraphQL, typowe integracje chmurowe),

- czasem „przeciąża” rozwiązania – generuje rozbudowane przykłady, które niepotrzebnie komplikują prosty problem,

- korzysta intensywnie z kontekstu publicznych repo, co bywa plusem (dobrze znane biblioteki) i minusem (przestarzałe wzorce).

- Codeium:

- często lepiej dopasowany do „surowego” kodu enterprise – mniej magii, więcej prostych struktur,

- silna strona: języki niszowe w środowiskach legacy (C++, Go, Kotlin w monorepo, wewnętrzne DSL‑e na bazie pluginów),

- bardziej konserwatywne propozycje – mniejsza szansa na „fajerwerki”, większa na przewidywalny kod.

- Cursor:

- lepszy w generowaniu modułów ściśle wtopionych w istniejącą architekturę – dzięki szerszemu kontekstowi projektu,

- często automatycznie proponuje podział na pliki, interfejsy, helpery,

- może jednak „przeintelektualizować” rozwiązanie, dodając zbyt wiele warstw abstrakcji.

Uzupełnianie w locie: „drugi mózg” czy generator szumu

Auto‑uzupełnianie stało się najbardziej „niewidoczną” funkcją asystentów – działa ciągle, trudniej więc ocenić jego realny wpływ na jakość. Różnice między Copilotem, Codeium i Cursorem wychodzą na jaw dopiero przy dłuższej obserwacji zespołu.

- Copilot:

- agresywny w proponowaniu całych bloków kodu, szczególnie w popularnych stosach (Node/React, .NET, Python),

- często „zgaduje” całe funkcje na podstawie nazwy i kilku linii kontekstu, co bywa świetne przy prostych handlerach, a ryzykowne przy krytycznych algorytmach,

- ma tendencję do utrwalania istniejących wzorców w repo – jeżeli w projekcie są złe praktyki, będzie je konsekwentnie powielał.

- Codeium:

- bardziej „punktowe” podpowiedzi niż całe bloki – preferuje uzupełnianie aktualnej linii, podpisów metod, prostych konstrukcji,

- sprawdza się tam, gdzie priorytetem jest czytelność i zgodność ze stylem, a nie maksymalne przyspieszenie pisania,

- w legacy (C++, Java z rozbudowanymi frameworkami) generuje mniej „magii”, za to trzyma się istniejących konwencji i typów.

- Cursor:

- uzupełnianie silnie sprzężone z historią czatu i kontekstem projektu – potrafi proponować kod spójny z decyzjami sprzed kilku godzin rozmowy,

- często sugeruje całe sekwencje zmian (np. funkcja + wywołanie + test), co mocno przyspiesza pracę, ale utrudnia precyzyjną kontrolę,

- przy długiej sesji może „przeciążyć” programistę ilością sensownych, ale zbędnych sugestii – szczególnie, gdy projekt nie ma jasno określonego stylu.

Punkt kontrolny dla lidera technicznego: obserwacja, czy velocity rośnie bez proporcjonalnego wzrostu szumu w PR (drobnica, duplikaty, nadmiarowy kod). Jeżeli recenzenci zaczynają w komentarzach powtarzać te same uwagi („za dużo logiki w jednej funkcji”, „zbędny helper”), to sygnał ostrzegawczy, że auto‑uzupełnianie jest akceptowane bezrefleksyjnie.

Refaktoryzacja: precyzyjne cięcie kontra „wielka przebudowa”

Refaktoryzacja to miejsce, gdzie w 2026 roku rozjeżdżają się oczekiwania i rzeczywistość. Asystent AI bywa traktowany jak automatyczny chirurg, podczas gdy w praktyce lepiej sprawdza się jako asystent przy drobnych zabiegach.

- Copilot w refaktoryzacji:

- dobry w mikro‑refaktoryzacji na poziomie pojedynczych funkcji: rozbijanie metod, zamiana callbacków na async/await, wprowadzanie prostych wzorców (Strategy, Factory),

- słabszy w zmianach przekrojowych obejmujących wiele modułów, szczególnie gdy design wymaga zrozumienia szerszego kontekstu biznesowego,

- ma tendencję do „upiększania” kodu (nowe helpery, aliasy) zamiast realnego uproszczenia przepływów.

- Codeium w refaktoryzacji:

- w środowiskach enterprise sprawdza się w standaryzacji stylu (np. ujednolicenie obsługi błędów, konwencji logowania, walidacji),

- dobrze radzi sobie z refaktoryzacją pod testowalność – wyciąga zależności, podpowiada interfejsy, separuje I/O,

- przy dużych monolitach jest bardziej zachowawczy – raczej sugeruje stopniowe porządki niż radykalne przebudowy.

- Cursor w refaktoryzacji:

- dzięki operacjom wieloplikowym realnie potrafi przepiąć cały moduł na nowy interfejs lub zmienić kontrakt API w kilkunastu miejscach naraz,

- przy dobrze opisanym celu (np. „wydziel moduł płatności z monolitu do osobnego pakietu”) często wykonuje 80% pracy, zostawiając człowiekowi decyzje brzegowe,

- główne ryzyko: powstawanie „refaktoryzacji bez projektu” – duże zmiany architektoniczne wykonane szybko, ale bez uprzednich ADR i planu migracji.

Zdrowe minimum procesowe to zasada, że każda większa refaktoryzacja z użyciem AI ma:

- zdefiniowane cele i kryteria sukcesu (np. redukcja zależności, poprawa testowalności, wydzielenie domeny),

- osobne zadanie/issue w backlogu z opisem, co zostaje, a co wolno zmienić,

- przynajmniej jedną ręcznie przygotowaną mapę zmian (diagram, szkic architektury), zanim pojawi się pierwsza komenda do asystenta.

Jeżeli zespół zaczyna wykonywać duże refaktoryzacje poprzez pojedyncze prompt‑y typu „uporządkuj ten moduł”, to punkt kontrolny dla architekta: rośnie ryzyko, że kod wizualnie wygląda lepiej, ale logika domenowa została uszkodzona lub rozmyta.

Testy jednostkowe i integracyjne: pomocnik czy alibi

Generowanie testów to kuszący obszar – AI daje szybkie pokrycie, ale bywa, że bardziej uspokaja sumienie niż faktycznie zabezpiecza system. Różnice między narzędziami istotnie wpływają na wiarygodność testów.

- Copilot w testach:

- szybko generuje testy jednostkowe do istniejących funkcji, szczególnie w popularnych frameworkach (Jest, xUnit, JUnit, pytest),

- ma tendencję do tworzenia testów „kopii implementacji” – sprawdzają te same szczegóły, które zaraz potem są refaktoryzowane,

- często pomija negatywne scenariusze i brzegowe dane, chyba że programista wyraźnie o nie poprosi.

- Codeium w testach:

- dobrze odnajduje się w dużych zestawach istniejących testów – potrafi dopisać nowe przypadki zgodne z istniejącym stylem i strukturą fixture’ów,

- sprawdza się przy generowaniu testów integracyjnych pod istniejące kontrakty API i kolejki,

- bywa zbyt zachowawczy w proponowaniu „ostrzejszych” case’ów – nie wybija programistów ze znanej strefy komfortu.

- Cursor w testach:

- korzystając z szerszego kontekstu, potrafi zbudować zestaw testów wokół konkretnego flow biznesowego (np. rejestracja użytkownika → płatność → faktura),

- jest w stanie jednocześnie zmodyfikować kod i testy przy wprowadzaniu zmiany, co przyspiesza development, ale rozmywa granicę między implementacją a walidacją,

- łatwo w nim wygenerować dużą liczbę testów o niskiej wartości – dużo przypadków, a mało realnych regresji wykrywanych w praktyce.

Punkt kontrolny dla QA: korelacja między liczbą testów generowanych z AI a faktyczną liczbą wykrytych regresji. Jeżeli setki nowych testów nie łapią błędów, które potem wychodzą na produkcji, oznacza to, że narzędzie zostało użyte jako alibi („mamy pokrycie”), a nie realna siatka bezpieczeństwa.

Praca z dokumentacją i wiedzą domenową

W 2026 roku asystent AI nie jest już wyłącznie narzędziem „do kodu”, lecz również do poruszania się po dokumentacji, ADR‑ach, standardach wewnętrznych. To obszar, w którym różnice filozoficzne trzech ekosystemów stają się bardzo widoczne.

- Copilot:

- w środowisku GitHuba integruje się z README, CONTRIBUTING, issue templates – potrafi streszczać i stosować te zasady w podpowiedziach kodu,

- na poziomie IDE bywa ograniczony do tego, co znajduje się w pobliżu aktualnie otwartych plików,

- z dokumentacją biznesową (Confluence, Notion) współpracuje raczej „przy okazji” – wymaga dodatkowych integracji lub ręcznego kopiowania treści.

- Codeium:

- dzięki elastycznemu indeksowaniu łatwo włącza w kontekst zewnętrzne repozytoria dokumentacji, specyfikacje OpenAPI, pliki konfiguracyjne,

- w środowiskach korporacyjnych dobrze nadaje się do zbudowania jednego punktu wejścia do dokumentacji technicznej,

- wymaga jednak świadomego zarządzania indeksami – jeżeli dokumentacja jest przestarzała, AI będzie ją wiernie powielać w odpowiedziach.

- Cursor:

- traktuje dokumentację jako kolejny element codebase – ADR, RFC i pliki Markdown są równorzędne z kodem przy budowaniu odpowiedzi,

- umożliwia prowadzenie dialogu na styku kodu i dokumentów („pokaż, gdzie ten ADR jest łamany w aktualnym kodzie”),

- przy słabej higienie dokumentacyjnej może wprowadzać w błąd, budując narrację na fragmentach, które przestały być aktualne kilka iteracji temu.

Minimum dla właściciela produktu technicznego to przegląd: jakie źródła wiedzy są faktycznie wpięte w narzędzie (repo, wiki, pliki konfiguracyjne) oraz kto odpowiada za ich aktualność. Jeżeli nikt nie czuje się właścicielem „prawdy referencyjnej”, asystent zacznie stopniowo tworzyć własną, opartą na zlepie kodu i nieaktualnych zapisów.

Bezpieczeństwo i compliance jako kryterium wyboru ekosystemu

Przy wyborze między Copilotem, Codeium i Cursorem organizacje wrażliwe na bezpieczeństwo i regulacje (finanse, healthcare, sektor publiczny) nie mogą poprzestać na marketingowych zapewnieniach. Potrzebny jest twardy zestaw kryteriów audytowych.

- Zakres i lokalizacja przetwarzania danych:

- czy kod źródłowy opuszcza infrastrukturę organizacji, czy może być przetwarzany lokalnie (on‑prem, VPC),

- czy dostawca umożliwia wybór regionu danych (UE, US, inne jurysdykcje) oraz zapewnia izolację tenantów,

- czy istnieją tryby „no training”, w których dane z zapytań nie są używane do dalszego trenowania modeli.

- Mechanizmy kontroli dostępu:

- czy integracja z SSO/IdP jest pierwszorzędnym mechanizmem (a nie dodatkiem),

- czy role i uprawnienia można mapować do struktur organizacyjnych (działy, domeny systemów),

- czy istnieją logi audytowe na poziomie workspace’ów, projektów i użytkowników.

- Obsługa tajemnic (secrets) i danych wrażliwych:

- czy narzędzie rozpoznaje i maskuje potencjalne secrety w wysyłanym kontekście,

- czy wspiera polityki DLP (Data Loss Prevention) w istniejącym ekosystemie bezpieczeństwa,

- czy administrator może wymusić reguły redakcji – np. blokadę wysyłania określonych folderów poza lokalny indeks.

W praktyce:

- Copilot jest najsilniej zintegrowany z ekosystemem Microsoftu – to plus, gdy organizacja już żyje w Azure/Entra, oraz minus, gdy wymagana jest pełna neutralność lub izolacja.

- Codeium częściej wygrywa tam, gdzie priorytetem jest on‑prem i pełna kontrola nad przepływem danych, nawet kosztem wygody wdrożenia.

- Cursor, jako narzędzie głównie „desktopowe”, bywa trudniejszy do centralnego uregulowania – wymaga dodatkowych polityk MDM/EDR i jasnych zasad, gdzie wolno go używać.

Jeżeli dział bezpieczeństwa nie jest od początku stroną w dyskusji o wyborze ekosystemu AI, rezultat jest przewidywalny: lokalne „wyspy” nieautoryzowanych narzędzi w zespołach, brak spójnej polityki oraz późniejsze, gwałtowne zakazy. To typowy sygnał ostrzegawczy z audytów 2025–2026.

Metryki jakości i produktywności: jak mierzyć efekty AI w kodzie

Najważniejsze punkty

- AI w IDE stało się w 2026 roku minimum higieny pracy programisty – brak Copilota, Codeium, Cursora lub alternatywy to sygnał ostrzegawczy, częściej świadczący o problemach kulturowych lub regulacyjnych niż o świadomej strategii technicznej.

- Doświadczone zespoły używają AI w całym SDLC: od generowania kodu, przez code review, testy, migracje frameworków, aż po dokumentację i onboarding; ograniczenie się tylko do podpowiedzi linii kodu oznacza, że ekosystem jest wdrożony powierzchownie i marnuje potencjał narzędzi.

- Rola programisty przesuwa się od „pisania kodu” do audytu jakości i projektowania architektury – punktem kontrolnym staje się umiejętność oceny ryzyka sugestii AI, korygowania ich pod kątem bezpieczeństwa oraz formułowania precyzyjnych poleceń zamiast mechanicznego przepisywania podpowiedzi.

- Definicja seniora uległa zmianie: doświadczony developer rzadziej implementuje moduły od zera, częściej ustawia kierunek prac, projektuje kontrakty między komponentami i weryfikuje propozycje generowane przez Copilota, Codeium czy Cursor, zapobiegając narastaniu długu technicznego.

- Standardem staje się „stack AI-tools”, a nie pojedyncze narzędzie: Copilot jako baseline do szybkich podpowiedzi, Codeium do scenariuszy z wysokimi wymaganiami prywatności oraz Cursor jako środowisko do głębokiej pracy nad złożoną codebase; wybór wyłącznie „bo inni tak mają” bez testów na własnym stacku jest wyraźnym sygnałem ostrzegawczym.